[Tweet «Estoy a punto de leer este articulazo sobre la búsqueda por voz»]

Introducción: el reconocimiento del habla

Desde Noviembre del 2008, Google utiliza los sistemas de reconocimiento por voz en iPhone y Android. En 2010 ya estaba disponible en varias versiones de español, y desde 2012 también en catalán. Durante todos estos años han ido almacenando la siguiente información de cada consulta realizada por voz:

- El país y el idioma

- Los datos de audio

- Lo que el sistema considera que se ha dicho

- Si lo seleccionas, también pueden almacenar el ID de tu cuenta de Google.

La conversión de los datos de audio en texto escrito resulta bastante compleja porque, como es obvio, cada persona habla de forma diferente. Incluso entre los habitantes del mismo país pueden variar múltiples factores como:

- La velocidad: además de hablar rápido o lento, normalmente acabamos las frases más rápido de lo que las empezamos.

- El acento, el tono y la entonación.

- Su naturalidad e inteligibilidad.

- Incluso la forma de hablar de una misma persona evoluciona con el tiempo.

No es, pues, tarea fácil el diseñar un solo modelo de reconocimiento de voz que funcione para todos los hablantes del mundo. Menos aún en lenguas donde la correspondencia entre el texto escrito y su equivalente fonético es poca (inglés) o ninguna (mandarín). Por ello, y con la finalidad de mejorar sus servicios de síntesis del habla, Google mantiene almacenados en sus servidores los datos de audio.

Según Wikipedia, la síntesis del habla es la producción artificial (no pregrabada) de habla humana. Este proceso consta de dos partes: back-end y front-end (sí, como tu CMS).

- El front-end preprocesa los textos y asigna una transcripción fonética a cada palabra, además de dividir y marcar el texto en varias unidades prosódicas como frases y oraciones.

- El back-end, más conocido como sintetizador, toma la representación lingüística simbólica y la convierte en sonido.

Cuando realizamos una búsqueda por voz en Google desde cualquier tipo de dispositivo, actúa el front-end de la síntesis de voz para convertir lo que hemos dicho en texto escrito. Si os fijáis, pasa como con el texto predictivo: mientras hablas, a la vez que escribe, va corrigiéndose ese texto escrito. Incluso hay veces en las que te corrige automáticamente (por ejemplo, cuando dices «comprar zapato» Google escribe «comprar zapatos»). Y en muchos casos, inmediatamente después actúa el back-end para leernos en voz alta el resultado que Google considera más relevantes.

Cómo nos localiza Google

Vamos a tratar de entender de qué forma nos localiza Google cuando realizamos una consulta por voz, y después analizaremos las respuestas que ofrece el buscador cuando se activa el back-end de su sistema de síntesis de voz.

Geolocalización de los usuarios

Google puede saber dónde estamos de varias formas:

- en primer lugar, puede usar información sobre el tráfico de internet (como la dirección IP que les facilita el navegador) para proporcionar la configuración regional y de idioma correspondiente. Este tipo de geolocalización se activa, por ejemplo, cuando le preguntamos a Google «¿Dónde estoy?«: usando Chrome Canary me ubica en Madrid, y usando Firefox me ubica en Málaga, que es donde realmente estoy, pero la ubicación apunta al centro de cada provincia.

- Luego están los sistemas de localización implícita, como indican en su blog oficial, donde lo definen así: «La información de ubicación implícita es información que, en realidad, no nos indica la ubicación de tu dispositivo, sino que nos permite determinar que estás interesado en ese sitio o que puedes encontrarte en ese lugar.»

Y nos ponen el siguiente ejemplo: «Si escribes «Torre Eiffel», deduciremos que posiblemente quieras obtener información sobre sitios cercanos a París y podremos utilizar esa información posteriormente para ofrecerte recomendaciones sobre esos sitios cercanos«. (Opinión: Donde dicen recomendaciones me ha parecido entender remarketing, pero bueno.) - Por último, si otorgamos los correspondientes permisos a la aplicación de búsqueda por voz en nuestro dispositivo, Google utilizará sistemas de localización mucho más precisos basándose en las señales de tu GPS, en tu punto de acceso wifi o en los indicadores de redes móviles. Y también podrá realizar algunas operaciones con tu móvil dando órdenes por voz, como abrir el correo o poner una alarma.

Quién usa las búsquedas por voz, para qué y porqué lo hace

Según un artículo publicado en el blog Google, encargaron una encuesta sobre el uso de las tecnologías de búsqueda por voz donde participaron 1.400 americanos. Según los resultados, el 55% de los adoslecentes y el 41% de los adultos utilizan las búsquedas por voz al menos una vez al día.

Como nota curiosa, dicen que el 45% de los adultos se siente «como un friki» cuando envía consultas de voz a su móvil. Y digo nota curiosa porque el móvil, en un principio ya lejano, fue inventado para hablar.

Continuando con el estudio, aporta datos sobre el uso que hacen los adultos de la búsqueda por voz:

- Preguntar por direcciones (40%)

- Dictar textos (39%)

- Llamar a alguien (31%)

- Reproducir canciones (11%)

- Ver la hora (11%).

- Encontrar horarios de películas (9%)

Pero hay muchos más casos de uso interesantes, como veremos más adelante.

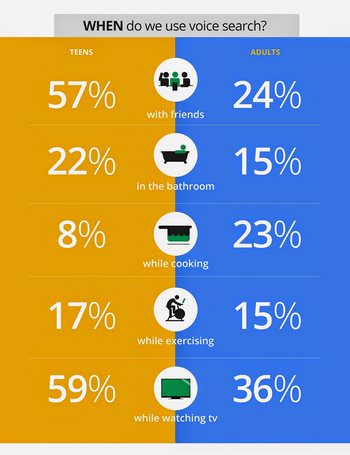

¿Desde dónde se utiliza?

A continuación, la infografía nos ofrece datos sobre los lugares donde se utiliza:

Donde usar la búsqueda por voz

Según la imagen, muchos usuarios realizan consultas por voz cuando están cocinando, haciendo ejercicio, viendo la tele o con amigos. Resulta llamativo el número de usuarios que dicen usar estos servicios desde el baño. La explicación que ofrece el blog de Google no se queda atrás: Tal vez estén creando reminders como:»Ok, Google, recuérdale a mamá que compre papel de WC la próxima vez que estemos en un Safeway».

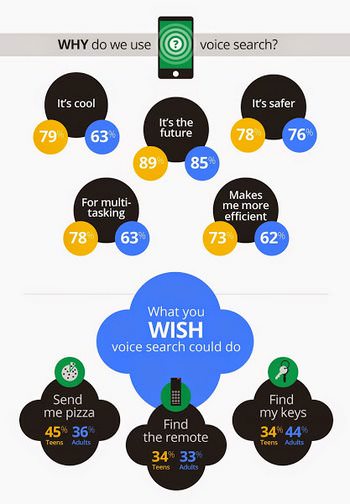

Para terminar, el estudio publica los motivos por los cuales usan estos sistemas y qué creen que deberían incluir en el futuro:

Por qué usan la búsqueda por voz

Los encuestados dicen que usar la búsqueda por voz es más seguro, les hace más eficientes y les permite realizar varias tareas a la vez. Esto es debido en gran parte a que la función «OK Google» permite realizar consultas por voz sin tener que tocar en ningún momento nuestro dispositivo. Puede ser útil cuando se está conduciendo o cocinando, por ejemplo.

Y, aunque el estudio no nombra en ningún momento la experiencia de usuarios con discapacidad en el uso de los sistemas de síntesis de voz, nosotros sí que vamos a hacerlo al final de este artículo. Probablemente, ellos son el grupo al que más se beneficia con los avances de la sintetización del habla.

¿Serps o respuestas directas?

En la práctica: ¿SERPs o respuestas directas en la búsqueda por Voz?

Cuando realizamos una consulta por voz, hay casos en los que únicamente actúa el front-end, como cuando buscamos «posicionamiento web«. Pero si cambiamos la consulta por «qué es el posicionamiento web«, además de mostrar unos resultado diferentes, se activará el back-end. Si tenemos los altavoces encendidos, escucharemos una voz femenina que nos lee en voz alta la respuesta que considera más relevante. En este caso, probablemente Google tenga mucho más claro el contexto y la intención de nuestra consulta, y probablemente sea esa la razón que le lleve a activar el back-end de la síntesis de voz.

Dicho de otra forma: cuando Google activa el back-end de su sistema de síntesis de voz, en la mayoría de los casos lo que pretende es darnos una respuesta directa.

Para tratar de comprenderlo mejor, vamos a observar la respuesta de Google en algunos casos donde actúan tanto el fron-end como el back-end. Y, como al back-end no le han puesto nombre, se lo voy a poner yo. Le llamaré Lisa:

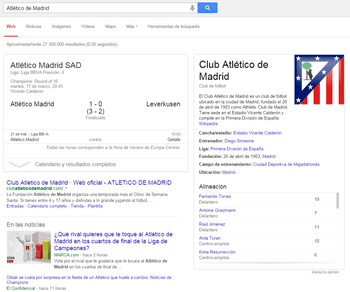

Consulta: «Atlético de Madrid»

Lisa: «El Atlético de Madrid ha ganado al Leverkusen uno a cero y juega el sábado contra el Getafe a las cuatro en punto«.

Búsqueda Atlético de Madrid

Consulta: «Producto Interior Bruto de España»

Lisa: «Uno coma tres nueve tres billones u ese de dos mil trece» (literalmente).

Consulta del PIB de España

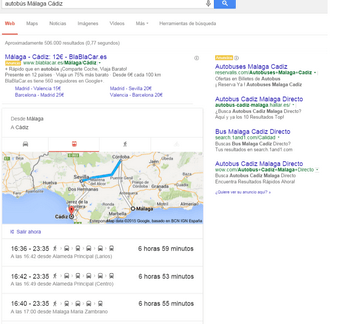

Consulta: «Autobús Málaga Cádiz» (algo parecido ocurre al buscar vuelos).

Lisa: En este caso, nos dice desde dónde se coge el autobús (el que ella considera más relevante) y a la hora que sale. Todavía tienen que mejorar un poco, porque para ir desde Málaga a Cádiz nos aconsejan dar un rodeo por Andalucía:

Autobús Málaga Cádiz

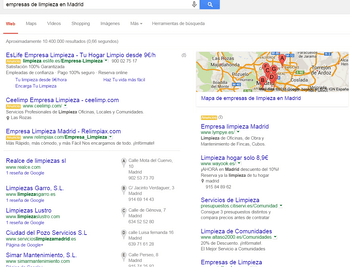

Consulta: «Empresas de limpieza en Madrid» (como podía haber puesto «restaurantes de comida japonesa en Cádiz, por ejemplo).

Lisa: «Estas son las fichas de empresas de empresa de limpieza en Madrid» (sí, se repite).

SERP:

Empresas de limpieza

En ocasiones, Google no sabe a qué nos referimos exactamente, o no lo dejamos claro:

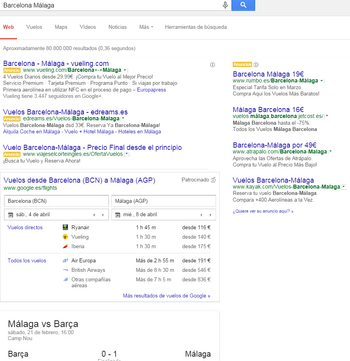

Consulta: «Barcelona Málaga».

Lisa: En ese caso, considera como resultados más relevantes los vueltos entre esas ciudades, pero también muestra el resultado del Barça (lo escribe así) – Málaga:

Malaga – Barça

Otras consultas en las que el back-end responde rápidamente son:

- Traducciones entre múltiples idiomas: amarillo en inglés, cómo se dice hola en japonés

- Preguntas sobre personalidades: dónde nació Einstein, quién es el presidente de Google

- Condiciones meteorológicas: el tiempo Málaga, viento Málaga, temperatura Málaga

- Datos de nuestro planeta, como la masa o el radio

- Operaciones artiméticas: sumas y multiplicaciones (cuarenta por dos), restas, raíces cuadradas

- Conversiones de unidades y monedas: cuánto son cuarenta kilómetros, cuántos euros son diez dólares

- Consultar la cartelera de tu ciudad: cartelera de cine Málaga

- Definiciones: qué significa prosodia, qué es la síntesis de voz

- Calcular la distancia entre lugares: distancia entre Pinto y Valdemoro, distancia entre la Tierra y la Luna

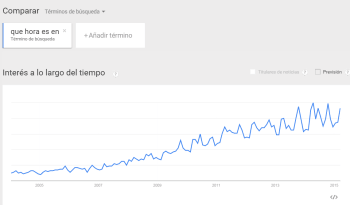

- Consultar la hora en cualquier país (curiosamente, no ofrecen una respuesta directa cuando preguntas «qué día es hoy»).

Y algunos ejemplos de consultas donde no se activa el back-end:

- Liga Española (raro que aquí no hable Lisa)

- Balón de oro dos mil catorce

- Buscar una canción: buscar «Para Elisa», por ejemplo.

Podemos dividir las SEPRs que hemos visto en dos grupos:

- Las que pueden satisfacer la consulta con una respuesta directa o un único resultado: PIB de España, cuántos euros son 10 dólares, Atlético de Madrid Leverkusen, definición de prosodia…

- Las que, aunque puedan tener una respuesta directa, ofrecen varios resultados para que el usuario elija el que considere más relevante.

El segundo caso, obviamente, es mucho más conflictivo ya que esas SERPs suelen estar directamente relacionadas con los negocios, como pueden ser:

- Los listados de empresas, donde, cada vez más, hunden los resultados orgánicos con Adwords + My Business + Maps.

- Los listados de productos, donde hay que sumar Shopping.

- Las búsquedas navegacionales + transaccionales, como el ejemplo que hemos visto de la consulta «Autobús Málaga Barcelona».

Muchos de estos cambios en páginas de respuesta de los resultados de búsqueda han sido posibles gracias a los avances de la semántica web, pero eso es un tema mucho más complejo. Si queréis informaros un poco sobre la semántica web os aconsejo ese interesante artículo de Sergio Redondo. Pero volvamos a la búsqueda por voz.

La búsqueda por voz y el SEO

¿Influye la búsqueda por voz en el SEO?

Todos los cambios que hemos visto en las SERPs son debido a la evolución del motor de búsqueda de Google y a la forma en que entiende la intención y el contexto de nuestras consultas. La búsqueda por voz puede contribuir a que Google tenga más resultados para analizar, y de esta forma puede estar contribuyendo indirectamente a mejorar los resultados de búsqueda.

Pero en lo que respecta al SEO, los resultados de búsqueda son los mismos independientemente de si realizamos la consulta de búsqueda de forma hablada o escrita, con la única diferencia de que, en algunos casos, cuando realizamos la búsqueda hablada nos contesta una voz femenina. Lo que sí que afecta al SEO es el dispositivo desde el cual realizamos la consulta, pero eso no tiene mucho que ver aquí, porque desde ordenadores de escritorio y tabletas también se pueden realizar búsquedas por voz.

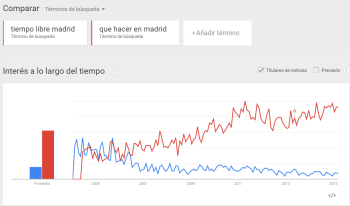

Quizás podamos afirmar, por ejemplo, que la búsqueda por voz puede promover búsquedas más largas y descriptivas. Pero personalmente creo que influye mucho más la experiencia previa de los usuarios con los motores de búsqueda: cuanto mayor sea su conocimiento de la forma en que se muestran los resultados, mejor sabrán afinar sus búsquedas con medium y long tail, indiferentemente de si se formula la consulta por voz o mediante texto escrito.

Para ilustrarlo podemos comparar, por ejemplo, las tendencias de búsqueda de «tiempo libre Madrid» (barra azul) y «qué hacer en Madrid» (barra roja):

Evolución de la forma de buscar

Otro ejemplo sería: «qué hora es en«. Como sabréis, Google genera una respuesta directa donde su sistema de sístesis de voz te lee en voz alta la hora actual de la ciudad que le digas. Si no dices ninguna ciudad, te contestará con la hora de la región donde te tenga geolocalizado. La clara tendencia en aumento de esta búsqueda concreta puede viene determinada por el conocimiento del usuario de las respuestas directas que genera Google:

Gráfica de volumen de búsquedas por hora

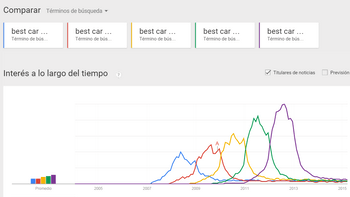

Igual ocurre con muchas búsquedas a las que añadimos el año: «best car 2008, best car 2009…»:

Búsqueda Time sensitive

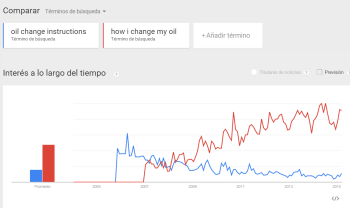

Este último ejemplo, tomado de una presentación de Avinash, también nos pueden ayudar a comprender, grosso modo, cómo evoluciona la forma de buscar de los usuarios con el tiempo. La tendencia que va aumentando es «how i change my oil«, en color rojo, y la barra azul es la tendencia de búsquedas de «oil intructions«:

Evolución del volumen: tendencias de búsqueda

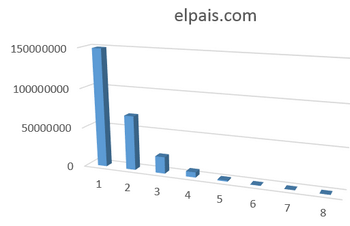

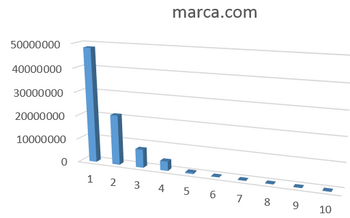

Otra posible forma de ilustrar ese pensamiento sería calculando las búsquedas de medium y long tail que usan los usuarios «normales» frente a los usuarios «avanzados». Para ello, vamos a calcular el número de palabras que utilizan para acceder a varios sites (eje X) y las sumas de los volúmenes de búsquedas de las mismas (eje Y).

Si extraemos tablas de Semrush de los sites de El País y Marca, cuyos usuarios son mayoritariamente «normales», obtendremos las siguientes gráficas para visitantes españoles:

Long tail de EL PAIS

Long tail de MARCA

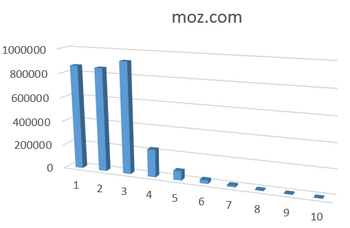

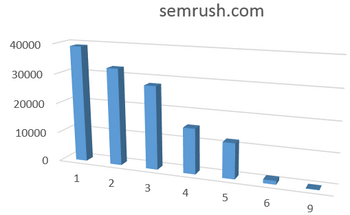

Y si hacemos lo propio con los visitantes de semrush.com y moz.com, cuyos usuarios suelen tener un mayor conocimiento del funcionamiento de los motores de búsqueda, obtendremos esta gráficas para los visitantes estadounidenses:

Long tail de MOZ

Long tail de semrush

De las gráficas se podría deducir que los usuarios más avanzados utilizan más el medium y long tail que los usuarios que tienen un conocimiento básico de los motores de búsqueda. Y, respondiendo a la pregunta, creo que la influencia de la búsqueda por voz en el SEO es prácticamente nula, por si no ha quedado claro.

[Tweet «‘La influencia de la búsqueda por voz en el SEO es prácticamente nula’ @electropunkys«]

El mejor sistema de síntesis de voz actual

¿Es Google Now el mejor sistema de síntesis de voz actual?

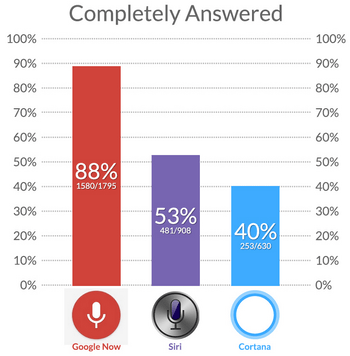

Los sistemas de síntesis de voz más conocidos son Google Now, Siri (Apple) y Cortana (Microsoft), creado por las grandes empresas, o Sherpa, creado en España. También se han interesado por estos sistemas otras grandes empresas como Yahoo y algunos fabricantes de móviles. Pero la síntesis de voz también es usada por personas ciegas para manejar sus dispositivos, y en ese campo, los softwares más utilizados son Jaws y NVDA.

En Stone Temple publicaron un estudio realizado sobre los tres más conocidos donde analizaban 3.086 consultas por voz, dando como claro ganador a Google Now:

Google now, respuestas completadas

Pero por otro lado, las personas ciegas, por ejemplo, prefieren utilizar programas específicos que les ayudan a manejarse con más rapidez y facilidad, como Jaws (de pago) y NVDA (software libre).

Una pequeña reflexión sobre Google

Una parte oscura de «the Sage»

Me gustaría terminar con una pequeña reflexión sobre el objetivo de Google. Hace poco, me llamó la atención el mensaje que muestran en su página «Sobre nosotros«:

Slogan de Google «Don’t be evil»

«El objetivo de Google es organizar la información del mundo y hacerla accesible y útil de manera universal«.

Es obvio e innegable que son los que más avances han aportado a la hora de organizar la información digital de forma que resulte útil y accesible para la gran mayoría de los usuarios. Además, Google ha desarrollado algunos productos y funciones de accesibilidad.

Pero la palabra universal incluye a la todo el mundo. Puede que ese lema sea su objetivo a medio o largo plazo, pero considero que, si quieren hacer la información accesible y útil de manera universal, deberían cambiar algunas cosas:

- Las personas con graves problemas visuales prefieren utilizar Jaws o NVDA para manejar y/u obtener información desde sus dispositivos porque estos programas están mucho más adaptados a sus necesidades. Resulta llamativo que una pequeña compañía diseñe un software que se adapta mejor que los productos de Google a las personas ciegas. A mí personalmente me llama la atención que Google todavía no haya comprado Jaws o NVDA, ni piense hacerlo..

- Google Now pasa mi voz a texto perfectamente, incluso hay veces que me corrige cuando pronuncio mal. Y el subtitulado automático de los vídeos de Youtube, cuando lo permiten, suele ser pésimo. Seguro que saben cómo mejorar también en este punto.

- También hay personas que no pueden mover los brazos y usan los dispositivos con un puntero láser en la boca o con los ojos, y que yo sepa Google no ha lanzado ningún producto ni investigación para ellos.

- La adaptación de la gran mayoría de las páginas de Google a las normativas Web Content Accesibility Guidelines (WCAG 1.0/2.0/ARIA) de la W3C es mejorable. Tampoco proporcionan atajos de teclado ni saltos a navegación o contenido.

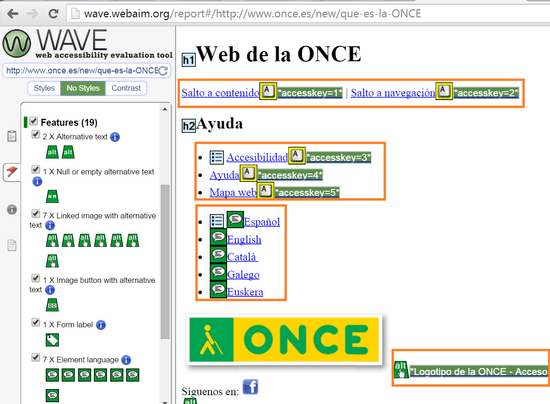

Un ejemplo práctico de buen hacer lo tenemos en la web de la ONCE. He usado la página wave.webaim.org para comprobar algunas de las implementaciones que han realizado:

- El correcto uso y marcado de atajos de teclado para facillitar y agilizar la navegación (accesskey=»1″ quiere decir que, pulsando el número 1, te lleva hasta ese marcador).

- Los idiomas han sido correctamente marcados y es muy fácil cambiarlos.

- Entre otros, también han marcado correctamente las imágenes.

Web de la ONCE

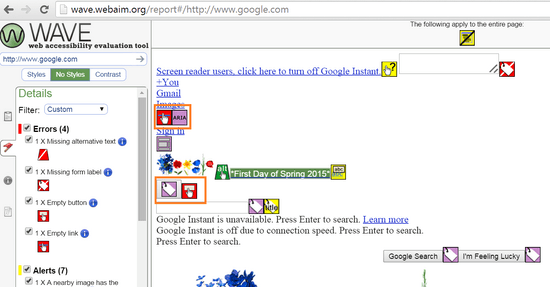

En cambio, si analizamos de google.com veremos que utiliza algunos atributos, pero no lo hace correctamente:

wave y google con sus atributos

- No proporciona atajos de teclado numéricos ni tampoco enlaces tipo «skip-to-content».

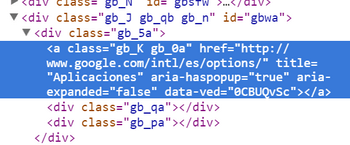

- El primer recuadro que he marcado se refiere a un error provocado por un enlace vacío:

Un enlace vacio

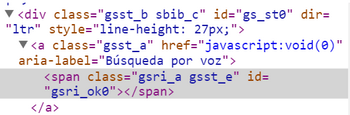

- El segundo rectángulo rojo se refiere a un botón que «no tiene nombre o texto», según la web que he utilizado para el test. Supongo que se refiere al botón que activa la búsqueda por voz, porque lo generan con Javascript.

boton que activa la búsqueda por voz, con javascript

No digo que sea un trabajo fácil de lograr, pero sí creo que, con los grandes recursos que tienen y la multitud de proyectos que han desarollado podían haber pensado un poco más en las personas discapacitadas. Así, de paso, cumplirían mejor con el lema de su propia marca.

[Tweet «Google podría pensar un poco mas en las personas con discapacidad ¿Don’t be evil?»]

Hacía tiempo que en esta web no se escribía desde fuera de la empresa, pero esperamos que este post de Jose Miguel Moreno (del que ya habréis oído hablar gracias a este post que escribió en el blog personal de Fernando Muñoz o gracias a cualquiera de los posts de su blog) sirva para resarcirnos. Si os gusta, compártelo.

Fuentes:

- Recomendaciones WCAG 2.0 de la W3C: http://www.w3.org/TR/WCAG20/

- Blog Google: encuesta sobre el uso de consultas de voz http://googleblog.blogspot.com.es/2014/10/omg-mobile-voice-survey-reveals-teens.html

- Reconocimiento de voz de Windows: http://windows.microsoft.com/es-es/windows/set-speech-recognition#1TC=windows-7

- Reconocimiento de voz de Yahoo: https://es.answers.yahoo.com/question/index?qid=20110525175536AAlDmHo

- Tipos de datos de ubicación que utiliza Google: https://www.google.es/intl/es/policies/technologies/location-data/

- Wikipedia: Prosodia (Wikipedia): http://es.wikipedia.org/wiki/Prosodia

- Wikipedia: Síntesis del habla http://es.wikipedia.org/wiki/S%C3%ADntesis_de_habla

- Avinash: Next Generation SEO: http://www.slideshare.net/pagetraffic/next-generation-seo?related=1

- Google Trends: https://www.google.es/trends/explore#q=best%20car%202008%2C%20best%20car%202009%2C%20best%20car%202010%2C%20best%20car%202011%2C%20best%20car%202012&cmpt=q&tz=

- NY Times: Google Now scores higher than Siri and Cortana: http://www.forbes.com/sites/eliseackerman/2014/10/10/google-now-scores-higher-than-siri-and-cortana-on-massive-knowledge-quiz-an-ai-breakthrough-not-so-fast/

- 2008: Google utiliza el reconocimiento de voz en iPhone: http://www.nytimes.com/2008/11/14/technology/internet/14voice.html?_r=2&partner=rss&emc=rss&oref=slogin&

[…] Miguel Moreno, La búsqueda por voz. Abril del […]